페이스북 AI, 유해 콘텐츠 못 걸러…총격 구분 못 해"

월스트리트저널 내부 문건 입수해 보도

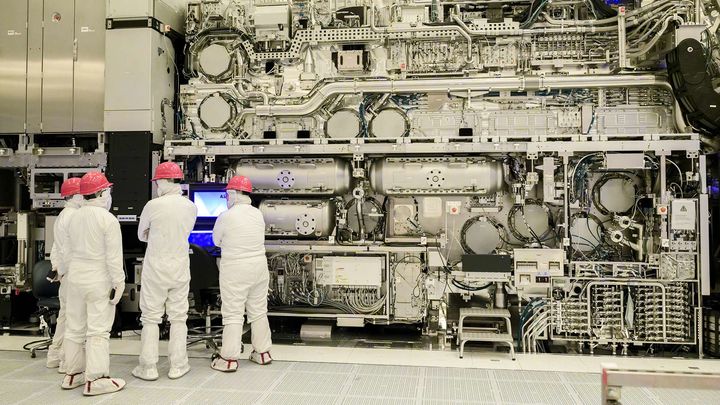

월스트리트저널(WSJ)은 17일(현지시간) 증오 발언, 과도한 폭력 등 규칙을 위반한 게시물을 삭제하기 위해 도입한 AI 시스템이 콘텐츠들의 차이를 일관되게 식별할 수 없는 것으로 드러났다고 보도했다.

WSJ가 입수한 페이스북 내부 문건에 따르면 2019년 중반의 한 수석 엔지니어는 회사의 AI 시스템이 자사 규정을 어긴 증오 발언의 2%만을 제거했다고 추정했다. 그는 "단기적으로 10~20% 이상으로 개선하기는 매우 어려울 것"이라고 분석했다.

올해 3월에도 또다른 페이스북 직원이 플랫폼에서 증오 발언의 3~5%만을 삭제한다고 추정하면서 비슷한 결론을 내렸다.

지난 2018년에는 페이스북의 한 엔지니어가 자동차 충돌 영상과 투계 영상이 확산되고 있다는 것을 파악하고 이를 삭제하도록 추진했다. 그러나 AI 시스템이 싸우는 닭과 싸우지 않는 닭을 구분하지 못 했다.

또 페이스북은 1인칭 총격 영상도 걸러내는 데 실패한 것으로 나타났다. 2019년 뉴질랜드에서 한 남성이 모스크에서 51명의 목숨을 앗아간 총격 사건 생중계 사건이 계기였으나, AI가 총격을 인식하지 못하고 페인트볼이나 세차와 혼동하기도 했다.

마크 저커버그 페이스북 최고경영자(CEO)는 지난 2018년 미 상원 청문회에서 페이스북이 5~10년 이내 대부분의 증요 표현을 사전에 감지할 수 있는 AI 시스템을 갖게 될 것이라고 낙관한 바 있다.

그는 지난해 7월에도 "증오와 싸우는 측면에서 정교한 시스템을 구축했다"고 강조했다.

하지만 이번 문건으로 드러난 통계에 대해 WSJ는 "마크 저커버그 CEO를 비롯한 페북의 경영진들이 제시한 AI의 자신감과 극명하게 대조된다"라고 지적했다.

◎공감언론 뉴시스 [email protected]

Copyright © NEWSIS.COM, 무단 전재 및 재배포 금지