"AI에이전트 시대, 프라이버시 체계도 진화해야" [GPA서울총회]

제47차 글로벌 프라이버시 총회(GPA) 서울…'AI 시대의 개인정보 이슈' 논의

"스스로 의사결정하고 업무수행하는 AI…책임 있는 설계와 운영 뒤따라야"

"에이전트형 AI 고도화될수록 eXplainable AI(설명 가능한 AI) 원칙 지켜야"

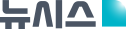

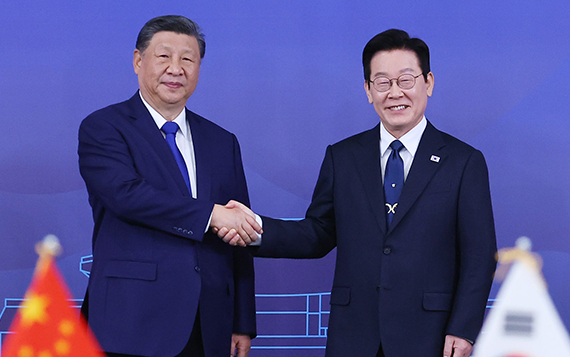

(왼쪽부터) 임용 서울대 로스쿨 교수, 존 에드워즈 영국 정보위원회(ICO) 위원장, 줄스 폴로네츠키 개인정보미래포럼(FPF) CEO 케이트 샬럿 구글 글로벌 프라이버시·안전·보안 부서장, 김유철 LG AI 연구원 전략부문장이 토론에 참여하고 있다. *재판매 및 DB 금지

[서울=뉴시스]송혜리 기자 = "인공지능(AI) 에이전트 시대, 프라이버시는 자율성과 투명성, 책임 있는 설계를 통해 지켜져야 합니다."

17일, 제47차 글로벌 프라이버시 총회(GPA) 서울 회의 셋째 날의 포문을 연 패널토론 'AI 에이전트와 프라이버시'세션에서는 자율성과 복잡성을 갖춘 차세대 AI 기술이 어떻게 개인의 정보 주권과 충돌할 수 있는 지를 놓고 전문가들의 열띤 토론이 펼쳐졌다.

좌장은 임용 서울대 로스쿨 교수가 맡았으며 패널로는 ▲존 에드워즈 영국 정보위원회(ICO) 위원장 ▲줄스 폴로네츠키 개인정보미래포럼(FPF) CEO ▲케이트 샬럿 구글 글로벌 프라이버시·안전·보안 부서장 ▲김유철 LG AI 연구원 전략부문장이 참여했다.

참석자들은 에이전트형 AI는 편의를 제공하지만 고도의 데이터 접근성, 인간의 감독이 제한된 의사결정, 장기적 데이터 보유 가능성 등으로 인해 새로운 개인정보 보호 위험을 초래하거나 기존 문제를 심화시킬 수 있다고 지적했다. 이에 따라 에이전트형 AI의 책임 있는 설계와 운영을 위해 기술적·제도적 기반이 필요하다고 제언했다.

자율성과 실행력 갖춘 에이전트형 AI, 산업 최적화 핵심

김유철 부문장은 "에이전트형 AI는 계획 능력과 실행력을 갖춘 시스템으로, 예를 들어 영상 보조 시스템을 통해 실제 상황을 인식하고 이에 따라 자율적으로 작업을 수행할 수 있다"고 말했다.

관련해 김 부문장은 LG AI연구원이 현재 중점적으로 연구 중인 두 가지 방향도 소개했다.

먼저 산업 최적화 분야다. 그는 화학 공장을 예로 들어 AI가 생산 현장을 실시간으로 관찰하고 생산과 판매 일정을 계획해 전반적인 공정 효율성을 최적화하는 작업을 수행할 수 있다고 설명했다. 적응형 AI 기술 개발도 언급했다. 환경 변화에 따라 학습하고 피드백을 반영해 결과물을 개선하는 방향으로 금융, 제조, 헬스케어처럼 환경 변화가 빈번한 산업군에 적용될 수 있다.

김 부문장은 에이전트형 AI를 설계하고 개발할 때 자율성, 내재된 적응성, 추론 능력 등 핵심 기능 뿐 아니라 AI 체이닝(AI가 AI를 호출하는 구조)과 같은 최신 기술을 고려해 저작권, 데이터 보호, 규제 준수도 철저히 설계 단계부터 반영하고 있다고 강조했다.

그는 "AI에이전트 기술에 대한 위험 요소들을 충분히 인지하고 있으며, 강건한 설계 차원의 개인정보 보호 장치를 도입 중"이라며 "동의 체계, 데이터 활용의 투명성, 정보 취약성에 대한 보호 원칙 등을 모두 고려한 시스템이 필요하다"고 밝혔다.

설명 가능한 투명성과 통제 가능한 자율성의 균형 필요

에드워즈 위원장은 "에이전트형 AI가 점점 더 고도화되면서 우리는 이 기술이 설명 가능해야 한다는 원칙, 즉 'XAI(eXplainable AI)의 기준을 충실히 따라야 한다"고 말했다.

그는 "에이전트형 AI는 기존 시스템과 유사한 데이터 기반 의사결정 구조를 가지면서도, 더 자율적이고 진화적인 성격을 띠고 있어, 프라이버시 보호 체계도 이에 맞춰 진화해야 한다"고 지적했다. 특히 "개인의 권리가 기술 구조 내에서 보장될 수 있도록 시스템 전반에 책임성과 통제력을 부여하는 것이 중요하다"고 덧붙였다.

이어 "설계 단계의 투명성, 응용 단계의 투명성, 규제 투명성이 함께 이뤄져야 한다"고 강조했다. 그는 "대규모 언어 모델(LLM)이나 확산 모델 등 AI가 사용하는 학습 방식에서도 언어 기반 패턴 인식과 학습이 진행되는 만큼, 사용자와의 투명한 소통이 매우 중요하다"면서 "AI가 '사용자를 대신해' 어떤 일을 한다면, 그 사실을 사전에 명확히 고지하고 동의를 구하는 체계가 반드시 필요하다"고 강조했다.

LG의 접근 방식에 대해서도 긍정적으로 평가했다. 에드워즈 위원장은 "LG처럼 프라이버시 중심 설계(Privacy by Design)를 개발 초기부터 적용하는 방식은 매우 고무적이며, 실질적인 리스크를 줄이면서도 사용자에게 혜택을 줄 수 있는 방향"이라고 말했다.

케이트 샬럿 구글 글로벌 프라이버시·안전·보안 부서장도 에이전트형 AI 개발 과정에서 '프라이버시 중심 설계'의 중요성을 강조했다.

샬럿 부서장은 "기술이 빠르게 발전하는 만큼, 처음부터 프라이버시 보호가 설계 구조에 내재돼야 한다"면서 "AI가 디바이스 단이든, 클라우드 기반이든, 개인정보 보호 원칙은 전 단계에 걸쳐 반영돼야 한다"고 말했다.

투명성 역시 핵심 가치로 제시했다. 그는 "AI가 어떤 방식으로 추론을 하는지, 사용자가 이해할 수 있는 수준의 설명이 가능해야 한다"면서 "모델이 특정 작업을 수행할 때, 예컨대 캘린더 일정 관리를 맡은 에이전트라면 맥락 정보만을 활용해야지, 사용자의 민감한 신원 정보는 포함돼서는 안 된다"고 말했다.

한편, GPA는 개인정보 보호 분야에서 가장 권위 있는 국제 협의체로 각국 규제기관과 전문가들이 한자리에 모여 글로벌 기준 마련, 법 집행 협력, 공동 조사 방안 등을 논의하는 장이다. 올해 서울 총회는 한국 개인정보보호위원회 주최로 열렸다. 아시아에서 총회가 열리는 것은 2017년 홍콩 이후 두 번째지만 국가 단위 주최는 한국이 처음이다.

◎공감언론 뉴시스 [email protected]

Copyright © NEWSIS.COM, 무단 전재 및 재배포 금지