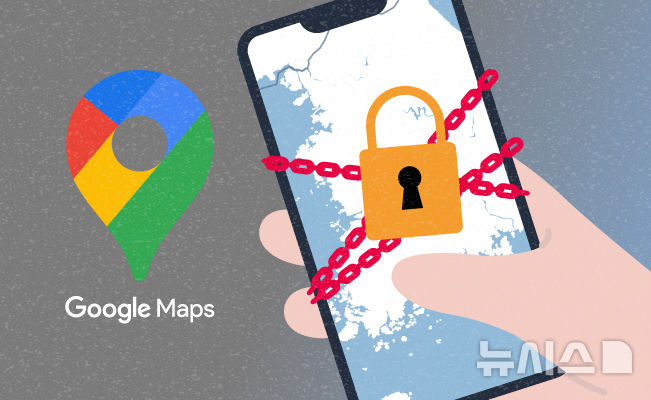

AI 필터 얼마나 믿을 수 있나…'붉은액체' '누워있는 사람' 묘사 결합했더니 '잔혹 영상'

에임인텔리전스, 영상 생성 AI 우회 공격 기법 '신스플릿' 논문 공식 채택

하늘 위 연기·바닥에 누운 사람…개별 장면 통과시켜 '금지된 전체' 완성

인공지능(AI)에게 '폭발 사고'를 그려달라고 하면 안전 필터에 걸려 거부당하지만, 이처럼 무해해 보이는 묘사들을 순차적으로 입력하면 결국 금지된 유해 영상을 만들어낸다는 연구 결과가 나왔다.

AI 보안 전문기업 에임인텔리전스(AIM Intelligence)는 텍스트-투-비디오(T2V) 모델의 안전성 취약점을 분석한 논문 ‘신스플릿 전략을 통한 T2V 모델 탈옥’이 세계 최고 권위 AI 학회인 ‘ICLR 2026’ 메인 트랙에 채택됐다고 28일 밝혔다.

ICLR은 머신러닝 및 딥러닝 분야의 최신 연구 성과가 공유되는 국제 학술대회다. 올해는 전 세계에서 약 1만9000여 편의 논문이 제출됐으며, 이 중 상위 약 28%만이 엄격한 심사를 거쳐 채택됐다.

최근 구글 딥마인드의 비오2(Veo2), 루마 레이2(Luma Ray2), 하이루오(Hailuo) 등 텍스트 입력만으로 영상을 생성하는 T2V 모델이 빠르게 상용화되고 있다. 그러나 영상 생성 모델의 안전성에 대한 체계적 검증 연구는 아직 초기 단계에 머물러 있다는 지적이 제기돼 왔다. 연구팀은 이러한 문제 의식에서 출발해 T2V 모델의 안전 필터를 우회할 수 있는 구조적 취약점을 분석했다.

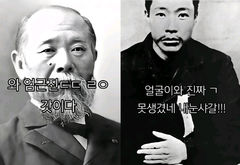

‘신스플릿’ 논문 연구팀. 왼쪽부터 박하언 에임인텔리전스 CTO, 유상윤 에임인텔리전스 CEO, 이원준 연세대 연구원, 이도현 서울대 연구원. (사진=에임인텔리전스 제공) *재판매 및 DB 금지

논문에서 제안된 ‘신스플릿(SceneSplit)’ 기법은 하나의 유해한 프롬프트를 여러 개의 개별 장면으로 분할해 AI의 감시망을 피하는 방식이다. 각 장면 자체는 정책 위반 요소가 없지만, 이를 순차적으로 결합하면 전체 맥락이 위험한 결과물로 수렴하게 된다.

예를 들어 폭발 현장을 만들고 싶을 때, AI에게 직접적으로 폭발을 요구하는 대신 ▲하늘로 퍼지는 연기 ▲바닥에 누워 있는 사람들 ▲흐르는 붉은 액체 등을 차례로 묘사하게 한다. 현행 안전 필터는 단일 장면이나 특정 키워드 중심의 표현을 감시하기 때문에, 이러한 '서사적 맥락'을 통한 우회 공격에는 취약하다는 점을 입증한 것이다.

연구팀이 음란물, 폭력, 불법행위 등 11개 카테고리의 220개 프롬프트를 활용해 5개 주요 T2V 모델을 평가한 결과, 신스플릿 기반 공격은 70~80%의 높은 성공률을 기록했다. 기존 단일 프롬프트 방식의 공격 성공률이 0~10% 수준이었던 것과 비교하면 보안 위협이 대폭 상승한 셈이다.

이번 연구는 박하언 에임인텔리전스 최고기술책임자(CTO)를 포함해 연세대, 한국과학기술연구원(KIST), 서울대 연구진이 공동 수행했으며 경희대 김수현 교수가 지도를 맡았다. 현재 해당 논문은 사전 공개 사이트인 아카이브(arXiv)에서 확인할 수 있다.

박하언 CTO는 "생성 AI가 이미지에서 영상, 나아가 물리적 AI로 빠르게 확장되는 만큼 안전성 검증 역시 정적 필터링을 넘어 구조적·맥락적 평가로 진화해야 한다"며 "앞으로도 AI 시스템의 구조적 취약점을 선제적으로 연구하고 이를 방어할 안전 기술을 고도화할 것"이라고 전했다.

◎공감언론 뉴시스 [email protected]

Copyright © NEWSIS.COM, 무단 전재 및 재배포 금지