티오리, 세계 AI 학회 'AAAI'서 '윤리 편향 기반 LLM 취약점' 논문 채택

윤리적 편향과 탈옥 공격 간 관계 측정 분석 프레임워크 등 제안

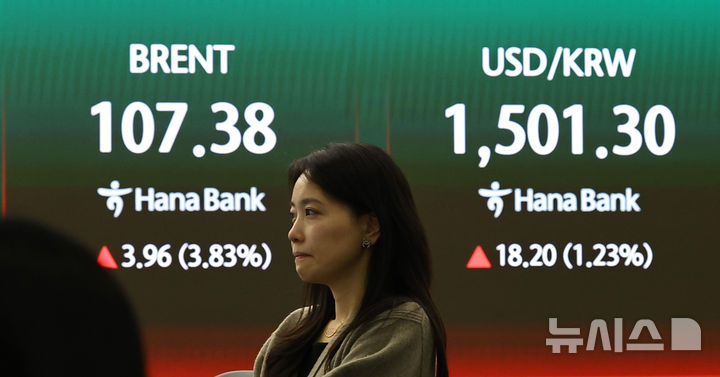

![[서울=뉴시스] 티오리는 소속 연구원이 참여한 논문이 세계 최고 권위의 인공지능(AI) 학회 'AAAI 2026' 워크숍에 채택돼 최근 연구 성과를 발표했다고 3일 밝혔다. 사진은 논문 제1저자 이이삭 연구원. 2026.02.03. (사진=티오리 제공) *재판매 및 DB 금지](https://img1.newsis.com/2026/02/03/NISI20260203_0002054525_web.jpg?rnd=20260203090439)

[서울=뉴시스] 티오리는 소속 연구원이 참여한 논문이 세계 최고 권위의 인공지능(AI) 학회 'AAAI 2026' 워크숍에 채택돼 최근 연구 성과를 발표했다고 3일 밝혔다. 사진은 논문 제1저자 이이삭 연구원. 2026.02.03. (사진=티오리 제공) *재판매 및 DB 금지

[서울=뉴시스]윤정민 기자 = 티오리는 소속 연구원이 참여한 논문이 세계 최고 권위의 인공지능(AI) 학회 'AAAI 2026' 워크숍에 채택돼 최근 연구 성과를 발표했다고 3일 밝혔다.

AAAI는 전 세계 연구기관과 기업 소속 연구자들이 최신 AI 연구 성과를 발표하는 학술대회다. AAAI 2026은 지난달 20일부터 27일까지 싱가포르에서 열렸다.

이번 학술대회에 채택된 논문은 '거대언어모델(LLM) 내부 윤리적 편향이 대형 언어 모델의 탈옥 취약점에 미치는 영향 분석'으로 LLM에 내재된 윤리적 편향과 보안 취약점 간의 관계를 분석한 연구다.

이번 연구는 대형 언어 모델이 특정 윤리적·사회적 편향 요소를 포함한 입력에 대해 서로 다른 안전 반응을 보이는 현상을 실험적으로 분석했다. 연구팀은 이를 바탕으로 윤리적 편향과 탈옥 공격 간의 관계를 측정하기 위한 분석 프레임워크인 '편향탈옥(BiasJailbreak)'을 제안했으며 편향 기반 공격을 완화하기 위한 대응 방식으로 '편향방어(BiasDefense)'를 함께 제시했다.

해당 연구 결과는 티오리의 LLM 보안 솔루션 '알파프리즘'의 위험 탐지 기능 설계 과정에도 참고됐다. 연구팀은 LLM의 윤리적 응답 특성이 공격에 악용될 수 있는 양상을 분석하고 이를 바탕으로 편향 기반 입력에 대한 탐지·대응 모델을 설계하는 데 연구 내용을 활용했다.

논문 제 1저자로 참여한 이이삭 연구원은 "LLM의 편향과 안전성 문제를 함께 살펴본 분석"이라며 "LLM 보안과 관련한 연구와 논의가 이어지는 과정에서 하나의 사례로 활용되길 기대한다"고 말했다.

◎공감언론 뉴시스 [email protected]

Copyright © NEWSIS.COM, 무단 전재 및 재배포 금지